一,jieba的介绍

jieba 是目前表现较为不错的 Python 中文分词组件,它主要有以下特性:

- 支持四种分词模式:

- 精确模式

- 全模式

- 搜索引擎模式

- paddle模式

- 支持繁体分词

- 支持自定义词典

- MIT 授权协议

二,安装和使用

1,安装

2,使用

三,主要分词功能

1,jieba.cut 和jieba.lcut

lcut 将返回的对象转化为list对象返回

传入参数解析:

1)精准模式(默认):

试图将句子最精确地切开,适合文本分析

2)全模式:

把句子中所有的可以成词的词语都扫描出来, 速度非常快,但是不能解决歧义;

3)paddle模式

利用PaddlePaddle深度学习框架,训练序列标注(双向GRU)网络模型实现分词。同时支持词性标注。

paddle模式使用需安装paddlepaddle-tiny,pip install paddlepaddle-tiny==1.6.1。

目前paddle模式支持jieba v0.40及以上版本。

jieba v0.40以下版本,请升级jieba,pip installjieba --upgrade。 PaddlePaddle官网

2,jieba.cut_for_search 和 jieba.lcut_for_search

搜索引擎模式

在精确模式的基础上,对长词再次切分,提高召回率,适合用于搜索引擎分词

3,jieba.Tokenizer(dictionary=DEFAULT_DICT)

新建自定义分词器,可用于同时使用不同词典。jieba.dt 为默认分词器,所有全局分词相关函数都是该分词器的映射。

四,添加自定义词典

开发者可以指定自己自定义的词典,以便包含 jieba 词库里没有的词。虽然 jieba有新词识别能力,但是自行添加新词可以保证更高的正确率。

1,添加词典用法:

2,其中自定义字典举例如下:

一个词占一行;每一行分三部分:词语、词频(可省略)、词性(可省略),用空格隔开,顺序不可颠倒。

3,使用自定义词典示例:

1)使用自定义词典文件

2)使用 jieba 在程序中动态修改词典

五,关键词提取

1,基于TF-IDF算法的关键词提取

1)TF-IDF接口和示例

- jieba.analyse.extract_tags(sentence, topK=20, withWeight=False,allowPOS=())

其中需要说明的是:- 1.sentence 为待提取的文本

- 2.topK 为返回几个 TF/IDF 权重最大的关键词,默认值为 20

- 3.withWeight 为是否一并返回关键词权重值,默认值为 False

- 4.allowPOS 仅包括指定词性的词,默认值为空,即不筛选

- jieba.analyse.TFIDF(idf_path=None) 新建 TFIDF 实例,idf_path 为 IDF 频率文件

2)关键词提取所使用逆向文件频率(IDF)文本语料库可以切换成自定义语料库的路径

用法:

jieba.analyse.set_idf_path(file_name) # file_name为自定义语料库的路径

自定义语料库示例:

3)关键词提取所使用停止词(Stop Words)文本语料库可以切换成自定义语料库的路径

- 用法: jieba.analyse.set_stop_words(file_name) # file_name为自定义语料库的路径

- 自定义语料库示例:

4)关键词一并返回关键词权重值示例

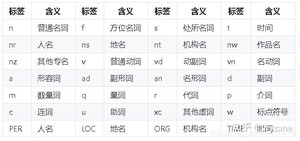

2,词性标注

- jieba.posseg.POSTokenizer(tokenizer=None) 新建自定义分词器,tokenizer参数可指定内部使用的 jieba.Tokenizer 分词器。 jieba.posseg.dt 为默认词性标注分词器。

- 标注句子分词后每个词的词性,采用和 ictclas 兼容的标记法。

- 用法示例

词性对照表

3,并行分词

将目标文本按行分隔后,把各行文本分配到多个 Python 进程并行分词,然后归并结果,从而获得分词速度的可观提升。用法:

- jieba.enable_parallel(4):开启并行分词模式,参数为并行进程数

- jieba.disable_parallel() :关闭并行分词模式

可参考 test_file.py

注意:基于 python 自带的 multiprocessing 模块,目前暂不支持 Windows

4,Tokenize:返回词语在原文的起止位置

1)默认模式

注意,输入参数只接受 unicode

2)搜索模式

5,搜索引擎ChineseAnalyzer for Whoosh

六,延迟加载

ieba 采用延迟加载,import jieba 和 jieba.Tokenizer() 不会立即触发词典的加载,一旦有必要才开始加载词典构建前缀字典。如果你想手工初始 jieba,也可以手动初始化。

上面代码中,使用 add_document() 把一个文档添加到了 index 中。在这些文档中,搜索含有 “basketball”和 “elegant” 的文档。

七,其他词典

1,占用内存较小的词典文件 https://github.com/fxsjy/jieba/raw/master/extra_dict/dict.txt.small

2,支持繁体分词更好的词典文件 https://github.com/fxsjy/jieba/raw/master/extra_dict/dict.txt.big

下载你所需要的词典,然后覆盖 jieba/dict.txt 即可;或者用

版权声明:

本文来源网络,所有图片文章版权属于原作者,如有侵权,联系删除。

本文网址:https://www.mushiming.com/mjsbk/12293.html